metadata

library_name: transformers

license: cc-by-nc-sa-4.0

language:

- ja

- en

base_model:

- CohereForAI/c4ai-command-r-v01

c4ai-command-r-v01-japanese-instruct

概要

CohereForAI/c4ai-command-r-v01を、ichikara-instructionを使って追加で日本語インストラクションチューニングを施したモデルです。

学習の設定

RunpodでGPUサーバを借り、A6000x4で学習を行いました。主な学習パラメータは以下の通りです。

- lora_r: 64

- lisa_alpha: 128

- lora_dropout: 0.05

- lora_target_modules: "q_proj", "k_proj", "v_proj", "oo_proj", "gate_proj", "up_proj", "down_proj"

- learning_rate: 2e-5

- num_train_epochs: 10epochs

- batch_size: 50

- max_seq_length: 2048

評価

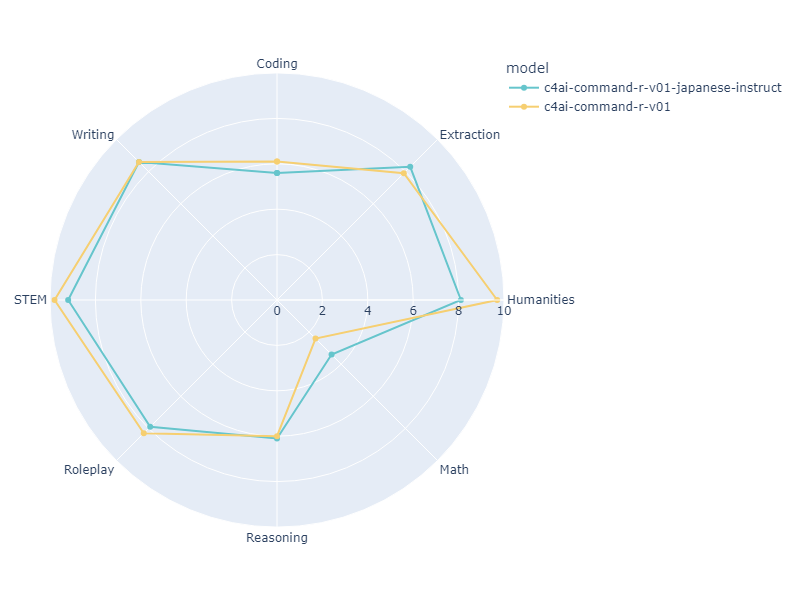

元モデルと本モデルのjapanese-mt-benchの結果は以下の通りです。(シングルターン、4ビット量子化)

スコア的にはあまり変わりませんでした。ただし、元モデルの出力の中には時々英語が混ざっていましたが、目視で確認した範囲だと混ざらなくなっていたので学習の効果は多少はありそうです。

| Model | Coding | Extraction | Humanities | Math | Reasoning | Roleplay | STEM | Writing | avg_score |

|---|---|---|---|---|---|---|---|---|---|

| c4ai-command-r-v01 | 6.1 | 7.9 | 9.7 | 2.4 | 6.0 | 8.3 | 9.8 | 8.6 | 7.35 |

| c4ai-command-r-v01-japanese-instruct | 5.6 | 8.3 | 8.1 | 3.4 | 6.1 | 7.9 | 9.2 | 8.6 | 7.15 |